Свет је на прагу масовне употребе борбених робота који самостално одлучују у шта гађати

- 23:41 02.01.2019.

- 0 коментара

- Штампај

БРИТАНСКА АРМИЈА ВЕЋ ИЗВЕЛА МАНЕВРЕ У КОЈИМА ЈЕ ВАЖНУ УЛОГУ ИМАЛО „АУТОНОМНОГ ОРУЖЈЕ“

* Стручњаци за компјутеризовану робототехнику Хоакин Родригес и Розер Мартинес, који раде за УН, упозоравају: „Машине које могу да саме бирају који циљ ће уништити – то је скок у непознато. Међутим, изгледа да већина човечанства то не жели да схвати. Такве машине могу бити смртоносне и по своје творце и командире“

* Противнике оваквог оружја – и ратова са његовом употгребом – посебно забрињава што ће вештачка интелигенција убрзо бити у стању да сама себе даље мења и усавршава. Кад се то догоди – борбени роботи могу почети да задатке и наредбе које буду добијали неправилним или за себе неприхватљивим, па почети да отказују послушност

_____________________________________________________________________________

СВЕТ је све ближе масовној употреби аутономних борбених машина - ратујућих робота.

Таквих да могу самостално и да одлучују на бојном пољу.

Поборници робота-ратника тврде да у биткама са њиховим учешћем неће бити више него мање људских жртава. Независно од тога, трка у роботизованом наоружању се увелико захуктава.

Би-би-си само што је објавио да су оружане снаге Велике Британије управо завршиле своје досад највеће војне маневре са важном улогом „аутономног оружја“. Уз учешће и тенкова са „дистанционим управљањем“.

Такви тенкови нису у пуном смислу „аутономно оружје“ јер немају сопствени интелект, способан за смостално доношење правилних војних одлука. Дакле: без човековог учешћа.

Стручњаци готово свакодневно упозоравају да такви војни роботи могу почети агресивни роботи рат против људи.

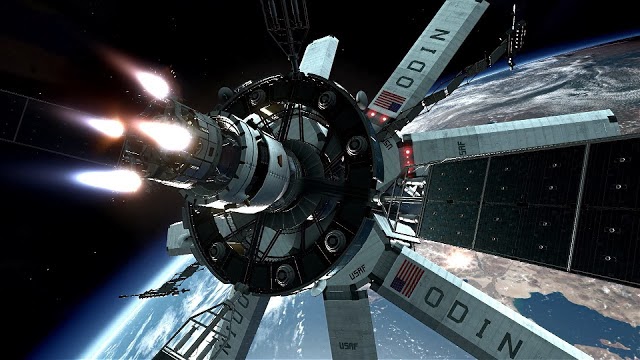

Шпански лист La Vanguardia пише да почиње да се обистињује оно што је Стенли Кјубрик уградио у свој познати филм «2001: Космичка одисеја», у којем компјутер HAL 9000 одлучује да нападне људску посаду свог космичког брода да посада не би уништила тај компјутер.

Стручњаци за компјутеризовану робототехнику Хоакин Родригес и Розер Мартинес истом листу су рекли, тачније – упозорили:

„Машине које могу да саме бирају који циљ ће уништити – то је скок у непознато. Међутим, изгледа да већина човечанства то не жели да схвати. Такве машине могу бити смртоносне и по своје творце и командире“.

Родригес и Мартинес су чланови експертске групе која под окриљем Уједињених нација ради на међународном споразуму против те врсте оружја.

На истој линији је и генерални секретар УН Антонио Гтереш који је крајем септембра 2018-те рекао:

„Перспектива појаве машина способних да убијају људе – одвратна је и аморална. Таква техничка достигнућа могу уништити човечанство као и нуклеарно оружје. Довољно ће бити да борбени роботи откажу послушност или да пређу у руке зла“.

За борбене роботе – а постоје и они који се понашају као подморнице и авиони-хеликоптери – користи се енглески назив Lethal Autonomous Weapons (LAWs).

Копнени су у неким случајевима добијали спољни изглед сличан људском.

А већ постоје борбени роботи у чијем фунцкионисању људски фактор има минималну или никакву улогу.

Примера ради, на лнији која дели Јужну и Северну Кореју постоје аутоматизовани системи за отварање ватре по свему што се креће по земљаи, чак и ако пузи.

Израелска „Гвоздена купола“, која служи одбрани од ракета, толико је аутоматизована да они који је контролишу имају само један задатк – да воде рачуна да њихов компјутерски систем непрекидно буде у функцији.

Против забране рада на борбеним машинама са вештачком интгелигенцијом су Израел, Француска, Јуна Кореје, Велика Британија, Кина, Русија и Сједињене Државе.

Противнике оваквог оружја – и ратова са његовом употгребом – посебно забрињава што ће вештачка интелигенција убрзо бити у стању да сама себе даље мења и усавршава.

Кад се то догоди – борбени роботи могу почети да задатке и наредбе које буду добијали неправилним или за себе неприхватљивим, па почети да отказују послушност.

Посебан проблем је што непријатељ може преузимати контролу над `маштинама за убијање` јер ће му за то бити довољно да само продре у компјутерски систем противничке војске

Поборници LAWs сматрају да би употреба тог оружја смањила људске губитке у ратовима. Јер, машине би се уништавале међусобно.