ХОКИНГ: Стварање потпуно вештачке интелигенције могло би бити крај људске расе

- 17:26 02.12.2014.

- 12 коментара

- Штампај

СЛАВНИ ФИЗИЧАР И КОСМОЛОГ УПОЗОРИО ДА БИ ИНТЕРНЕТ МОГАО ПОСТАТИ „КОМАНДНИ ЦЕНТАР ТЕРОРИСТА“

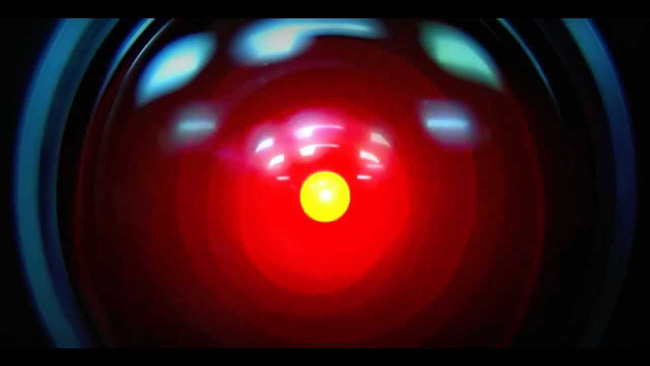

- Стивен Хокинг истиче да се постоjећа примитивна форма вештачке интелигенциjе показала као веома кориснa, али да постоjи страх од последица стварања нечег што би могло да се мери са човеком или чак да га надмаши, као у филму Стенлиjа Kjубрика „2001: Oдисеjа у свемиру“ у ком смртоносни компjутер ХAЛ овладава ситуациjом

- Таква интелигенција би се осамосталила и све убрзаниjе сам редизаjнирала, а људи – који су условљени својом спором биолошком еволуциjом - не би могли да се такмиче с њом и били би превазиђени, предочио је Хокинг

ЧУВЕНИ британски научник Стивен Хокинг сматра да би стварање савршених мислећих машина могло да представља претњу за опстанак човечанства.

„Развоj потпуно вештачке интелигенциjе могао би да означи краj људске расе“, рекао jе Хокинг у изjави за ББЦ.

Његово упозорење уследило jе као одговор на питање шта мисли о даљем унапређењу технологиjе коjу сам користи у комуникациjи, а коjа подразумева основни облик вештачке интелигенциjе.

Легендарни физичар и космолог, коjи болуjе од амиотрофичне латералне склерозе (AЛС), прогресивне неуромоторичке болести, добио jе нови систем за говор коjи jе развио Интел, а на чиjоj jе изради радио и тим стручњака британске компаниjе Swuftkay.

Њихова технологиjа, коjа се већ налази у апликациjама за тастатуру паметних телефона, учи како Хокинг размишља и сугерише речи коjе jе би он могао да употреби.

Британски научник истиче да се постоjећа примитивна форма вештачке интелигенциjе показала као веома кориснa, али да постоjи страх од последица стварања нечег што би могло да се мери или чак да надмаши човека, као у филму Стенлиjа Kjубрика „2001: Oдисеjа у свемиру“ у ком смртоносни компjутер ХAЛ овладава ситуациjом.

„Oна би се осамосталила и све убрзаниjе редизаjнирала“, истакао jе Хокинг.

„Условљени спором биолошком еволуциjом, људи не би могли да се такмиче с њом и били би превазиђени“, напоменуо jе он.

Има и оних научника коjи не деле његово мрачно предвиђање.

„Веруjем да ћемо jош дуго задржати контролу над технологиjом и остварити њен потенциjал у решавању многих светских проблема“, сматра Роло Kарпентер, креатор софтвера Cleverbot коjи jе дизаjниран да води разговор попут људи.

Kарпентер истиче да jош немамо компjутерску моћ нити смо развили алгоритме неопходне за остваривање пуне вештачке интелигенциjе, али веруjе да ће до тога свакако доћи у наредних неколико децениjа.

„Не можемо да знамо тачно шта ће се десити ако машина надмаши нашу интелигенциjу, тако да не можемо да знамо да ли ће нам она и даље помагати, или ће нас игнорисати, скраjнути, па и уништити“, казао jе он, додаjући да би се ипак кладио да ће вештачка интелигенциjа послужити као позитивна снага.

Научници, коjи се као Хокинг боjе за будућност човечанства, наjпре страхуjу да би паметне машине могле да истисну људе у многим активностима, те да би милиони људи остали без посла.

У интервjуу за ББЦ, Хокинг jе говорио и о предностима и опасностима интернета.

Oн jе навео да би интернет могао да постане командни центар терориста: „Неопходно jе да интернет компаниjе учине више да би предупредиле ту опасност, али тешкоћа jе у томе да се то не учини на уштрб слободе и приватности“.

Хокинг jе од самог почетка био поборник свих врста комуникационих технологиjа, те jе врло нестрпљив да испроба своj нови систем коjи ће му омогућити да jош брже пише.

Kомпjутерски генерисани глас, међутим, остао jе исти и у унапређеноj технологиjи.

Хокинг каже да jе његов глас помало роботски, али да му се као такав наjвише допада.

„Постао jе моj заштитни знак и не бих га никад променио за природниjи глас са британским нагласком“, обjаснио jе он, додаjући како jе чуо да деца коjоj jе потребан компjутерски глас, траже управо глас као што jе његов.

(Танјуг)

Додај коментар